一方、Apple の複合現実ヘッドセットの歴史的なリリース間近に迫った今日、同社が iPhone と iPad の可能性のある機能に関する特許を申請したことを知りました。これには、拡張現実で環境を読み取ることが含まれます。クパチーノのエンジニアも特定のユーザーデータを収集します(匿名) Apple より この機能を強化する予定です。

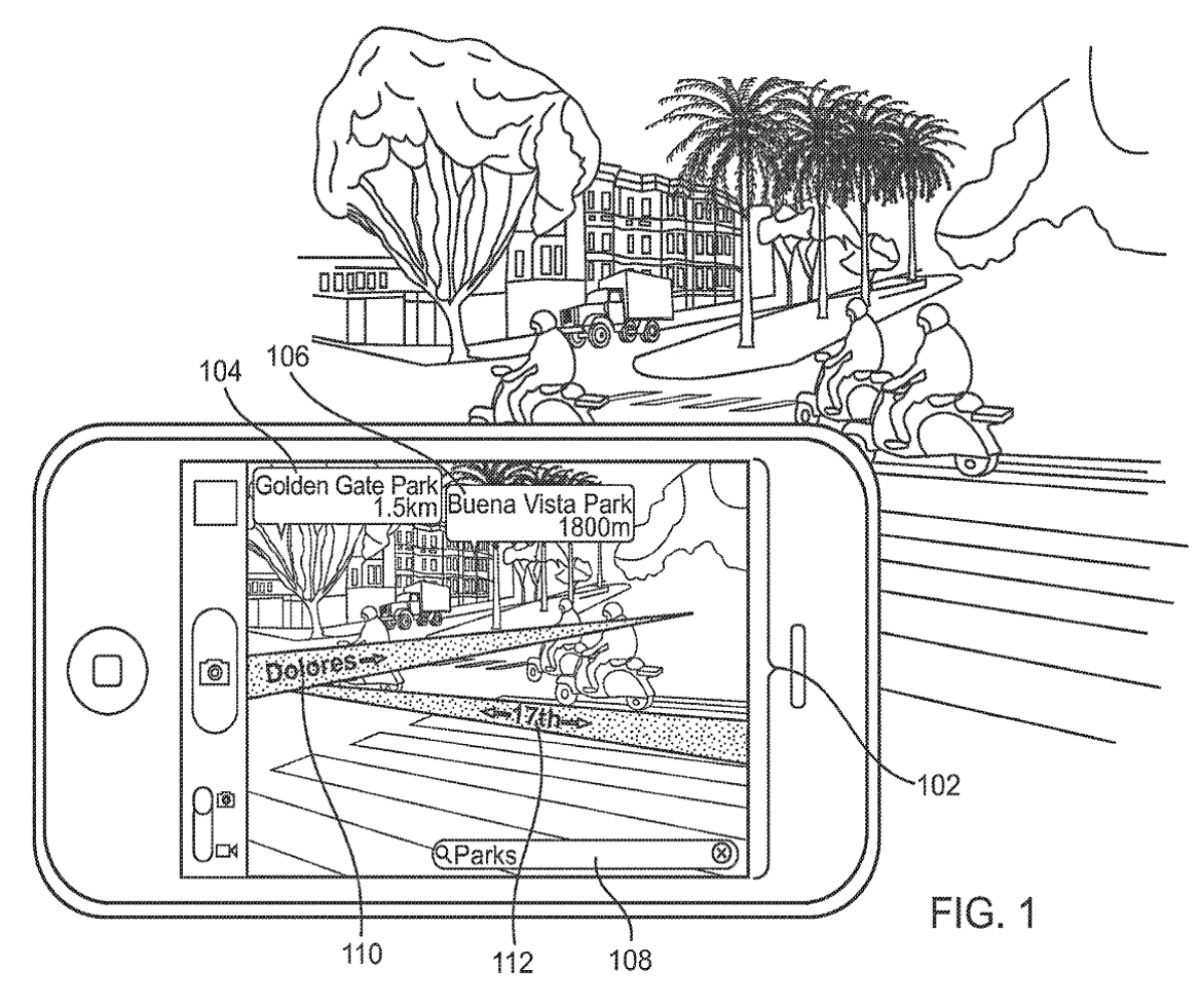

拡張現実とは、仮想要素を現実の環境に統合することを指します。 Apple の特許の場合、これにも番号が付けられています米国 20230417567 A1、それは機能の提供の問題になります私たちの周りの興味のある場所をライブで見つける可能性、次にオプションのルートを提案します。

グーグルと呼ばれる同様の機能もすでに含まれていますレンズで地図とストリートビュー : «マップのレンズのおかげで、ストリート ビューのようにナビゲートし、建物を観察するだけで、その秘密がすべて明らかになります。。 »

Apple 社は革新を進めていますが、それは複雑です

Apple の特許側では、機能を示す視覚的なスケッチが次のとおりです。

©アップル

との違いレンズで地図それは?Apple はデバイスのカメラを直接使用して、キャプチャされた環境からデータを抽出します。グーグル彼の側で使用するストリートビューしたがって、これを実現するためにカメラにアクセスする必要はありません。そのツールはどのデバイスでも使用できます。

しかし、Apple が検討しているテクノロジーは、それが拡張現実でのリアルタイム環境分析。。それデバイスのカメラと「携帯通信デバイス」のおかげで»検出できる«地理的位置とカメラの方向»。

同社は拡張現実でルートを提供するオプションも検討していただろうが、これを実装するのは複雑なようだ。現時点では、Apple はその可能性を検討しているユーザーを Apple マップなどの従来のナビゲーション アプリケーションにリダイレクトするには、拡張現実を通じて興味のある場所を見つけたら。

Apple による特許概要の翻訳は次のとおりです。携帯通信デバイスは、ビデオ フィードをリアルタイムでキャプチャして表示できます。携帯通信装置は、携帯通信装置の地理的位置およびカメラ方向を検出する。携帯通信装置の地理的位置から対象地点までのルートが特定される。キャプチャされたビデオ ストリームには、関心のある地点まで進むべき方向を示すインジケーターが視覚的に追加されます。インジケーターは、リアルタイムでキャプチャされたビデオ ストリームに重ねられます。»